把 OpenClaw 跑起来

这个章节中,你将了解搭建 OpenClaw 的环境要求,具体的安装流程,以及初始化向导中的一些推荐配置。

环境要求

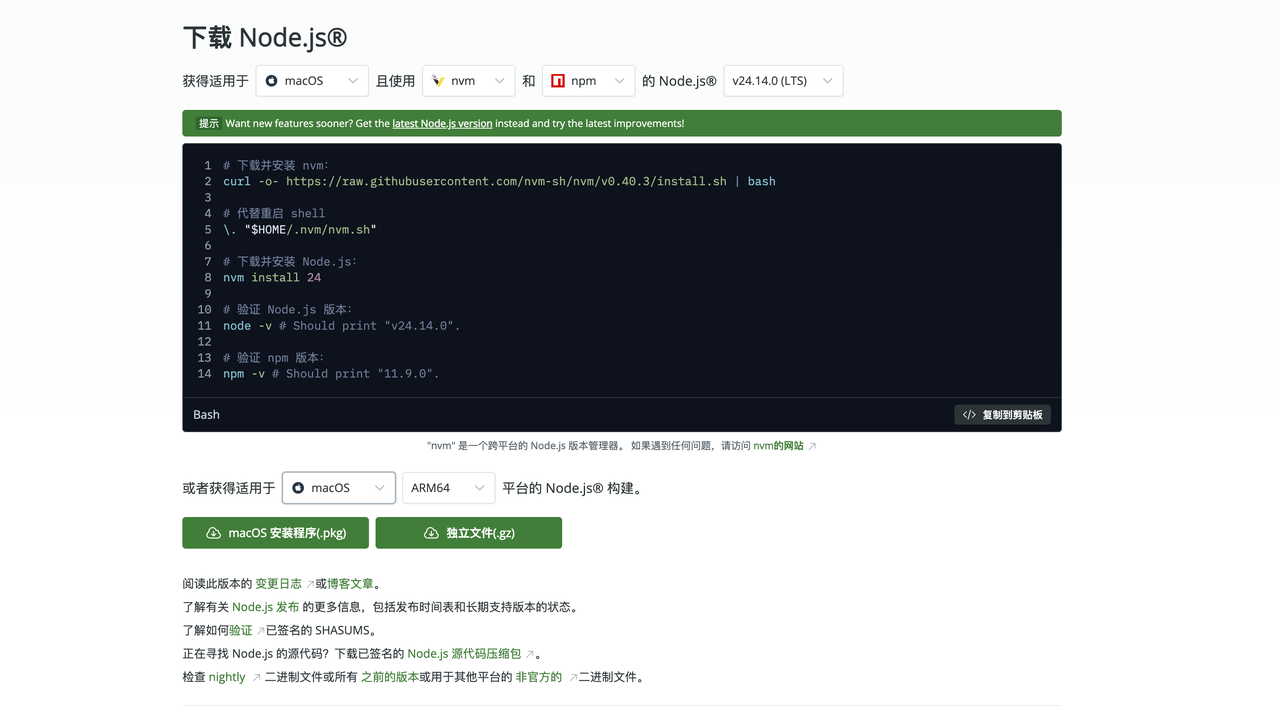

安装 OpenClaw 需要 Node.js 22 以上的版本。

Node.js 安装方式1:图形界面安装:

- 打开官网:https://nodejs.org/,直接下载「LTS版」的.pkg安装包;

- 双击下载的.pkg文件,依次点击「继续」→「同意」→「安装」,输入电脑密码验证权限;

- 等待安装进度条走完,点击「关闭」即可。

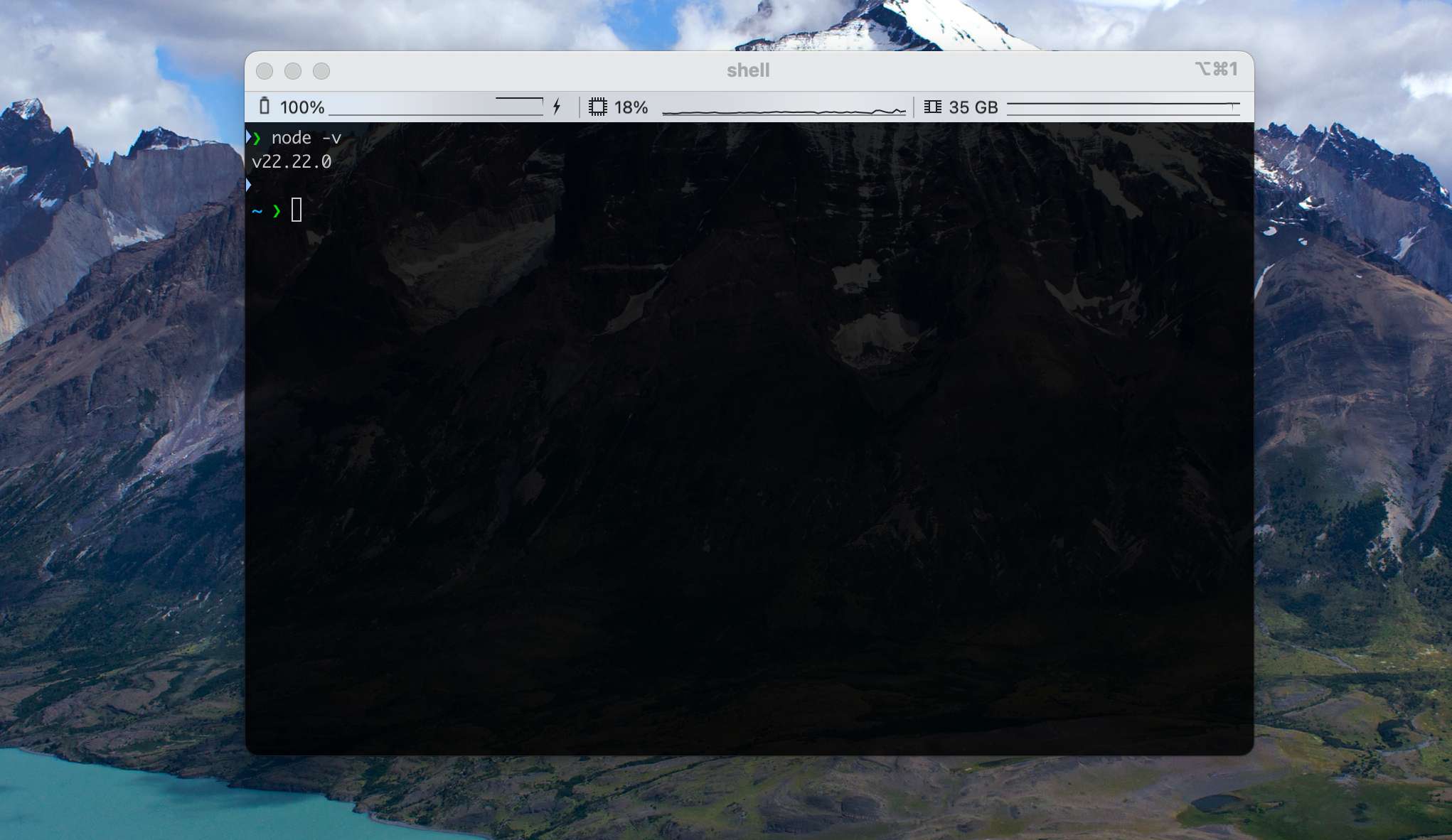

Node.js 安装方式2:Homebrew 安装

打开终端,输入一行命令:

brew install node安装完成后,在命令行执行命令:node --v ,若看到版本号 >= v22:可以继续后续的安装操作

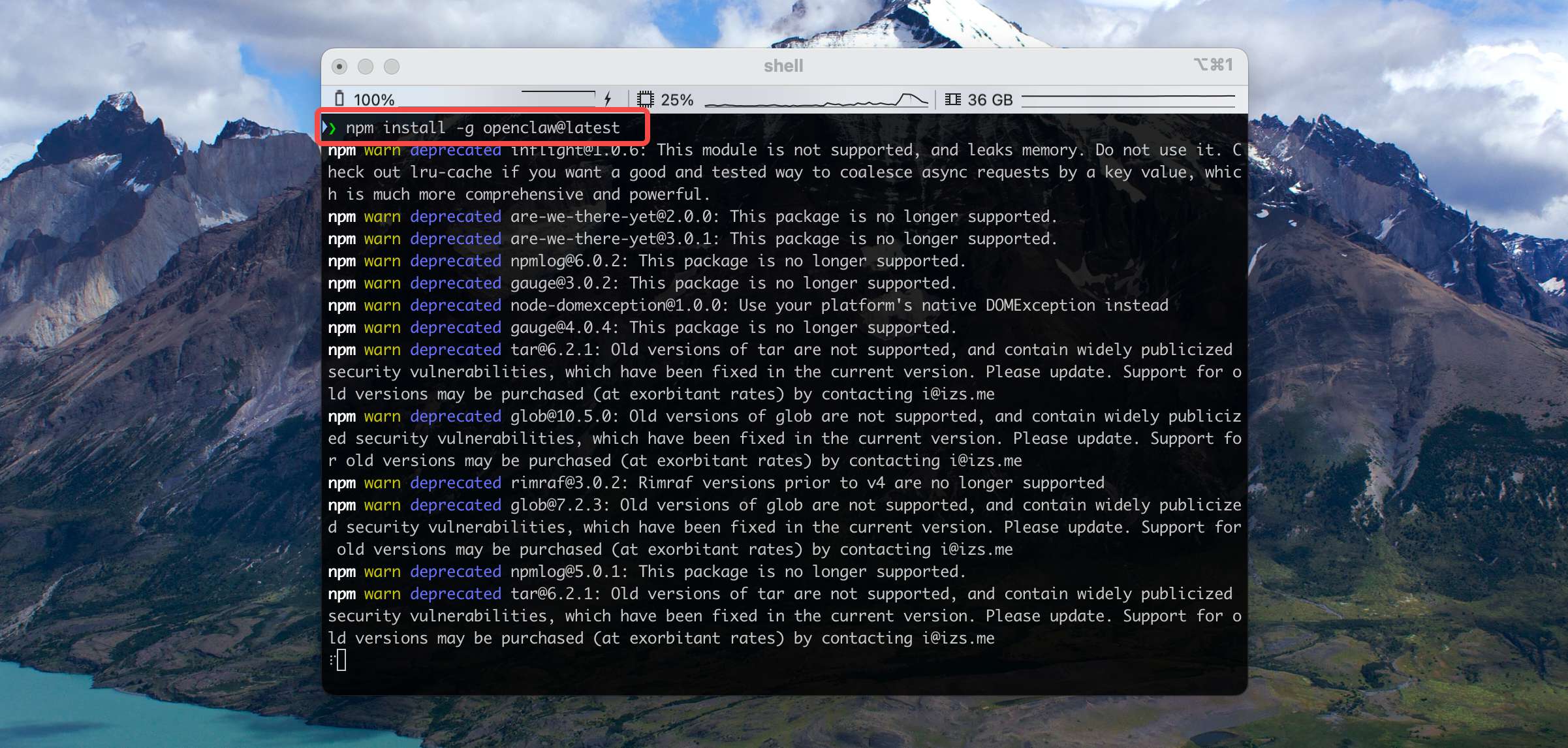

安装命令

现在你的电脑上已经拥有了 Node.js 环境,我们推荐使用 npm 来安装 openclaw,就下面一行代码:

npm install -g openclaw@latest然后静静等待几分钟即可,中间输出的 warning 可以直接忽略:

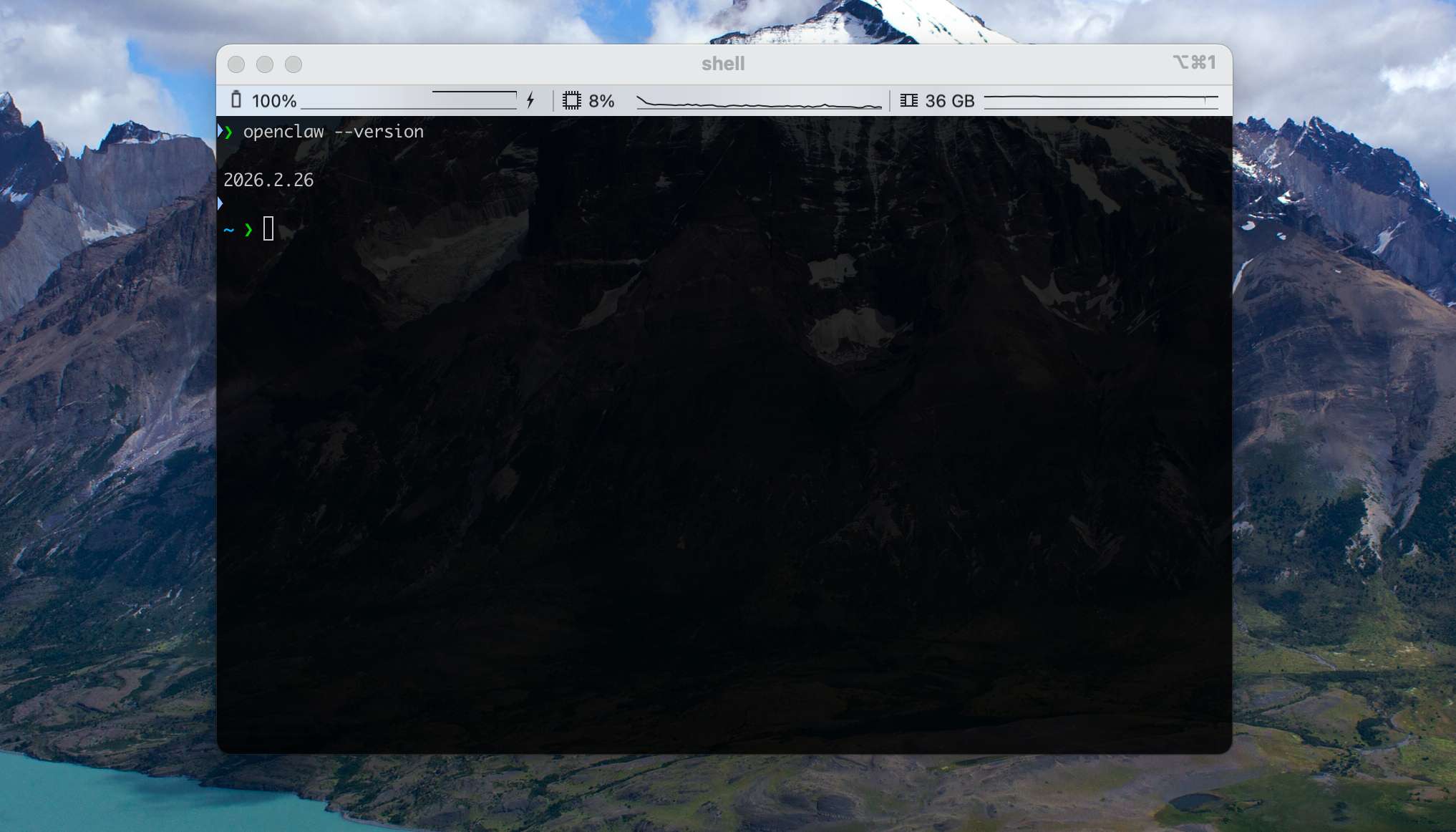

安装成功后,我们执行 openclaw --version ,如果看到类似的版本号,说明安装成功:

配置向导

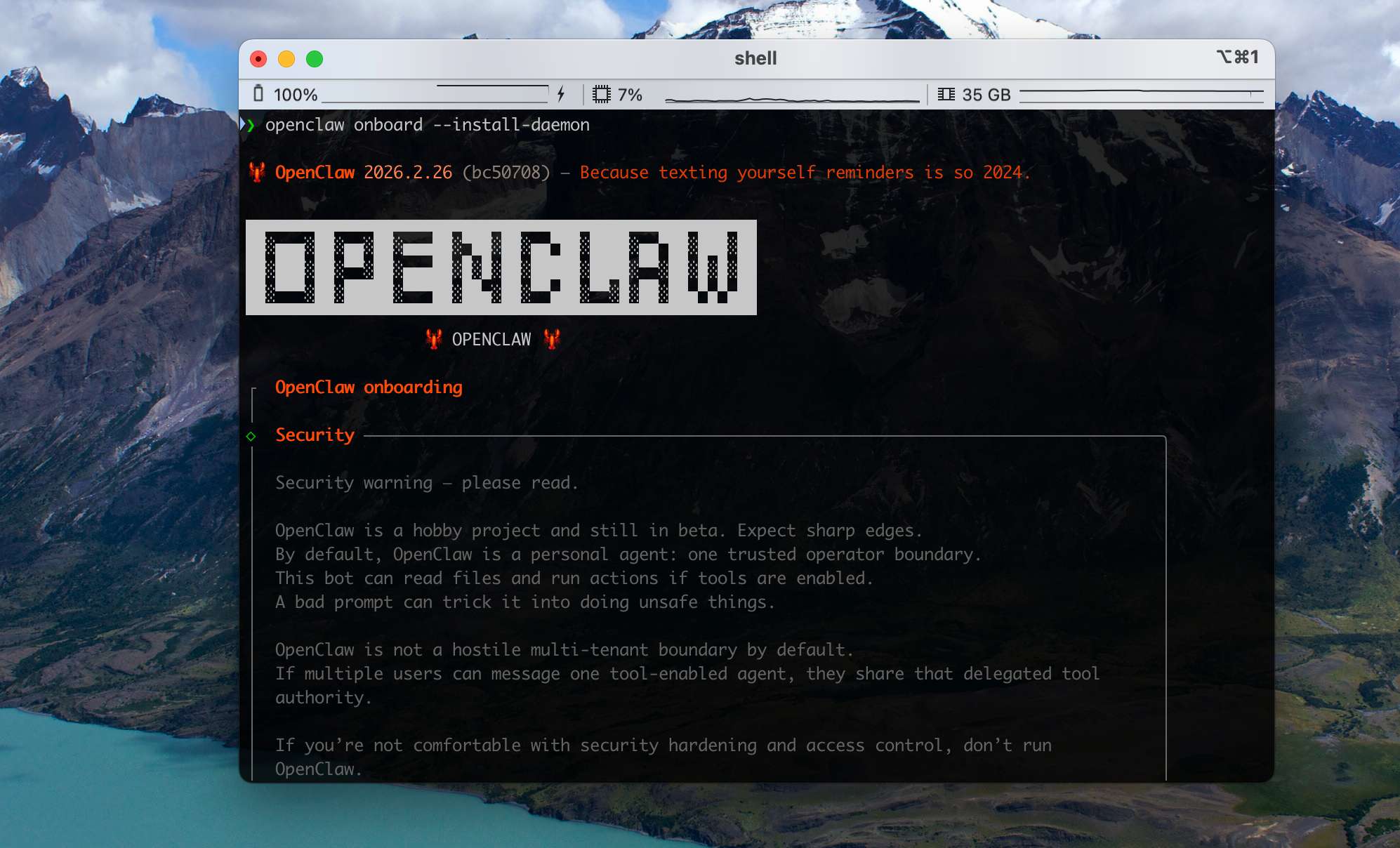

接下来,我们运行 openclaw 提供的初始化向导来完成一些必要的配置,执行下面的命令:

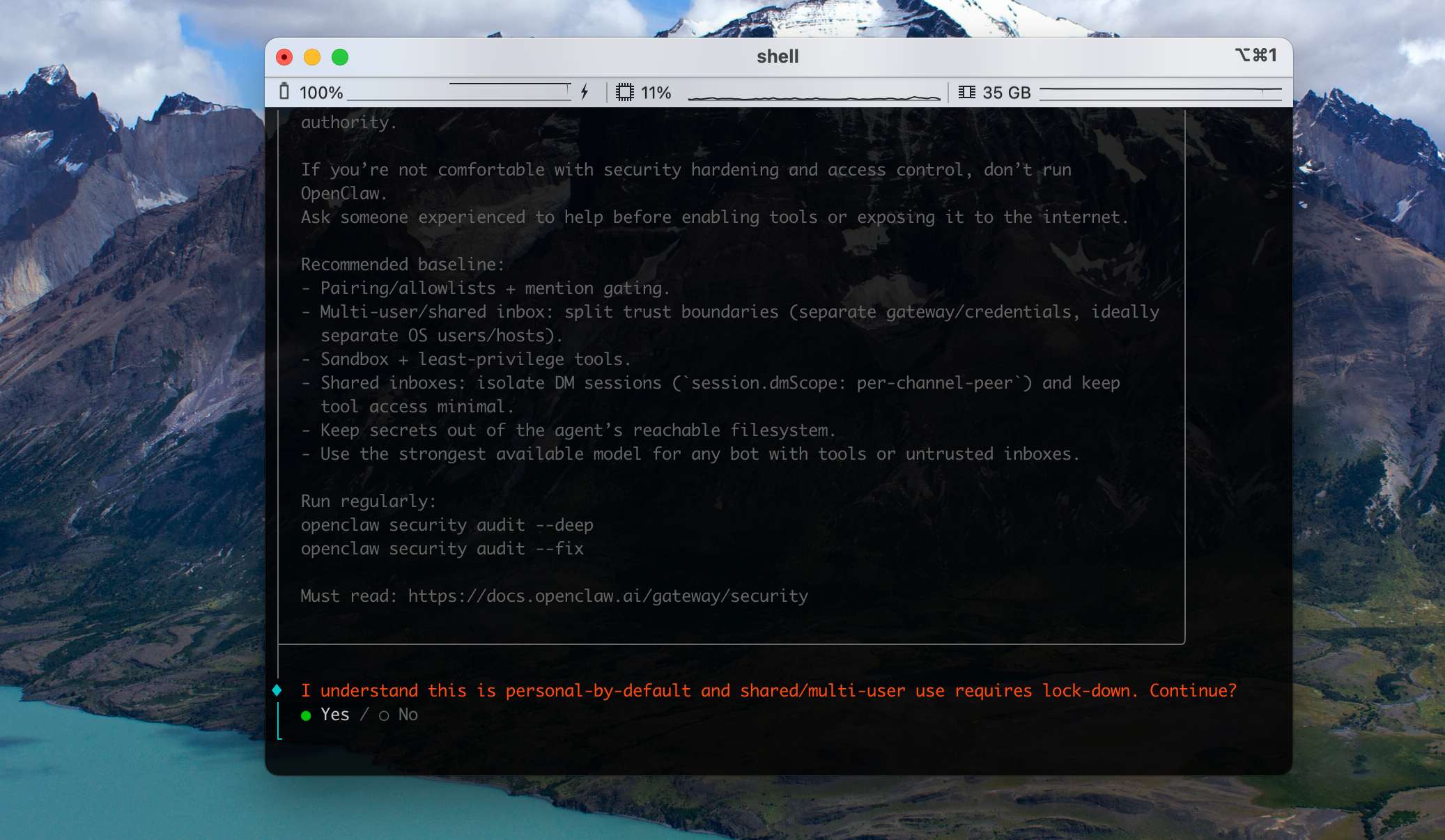

openclaw onboard --install-daemon首先,你会看到 openclaw 给出的安全提示:

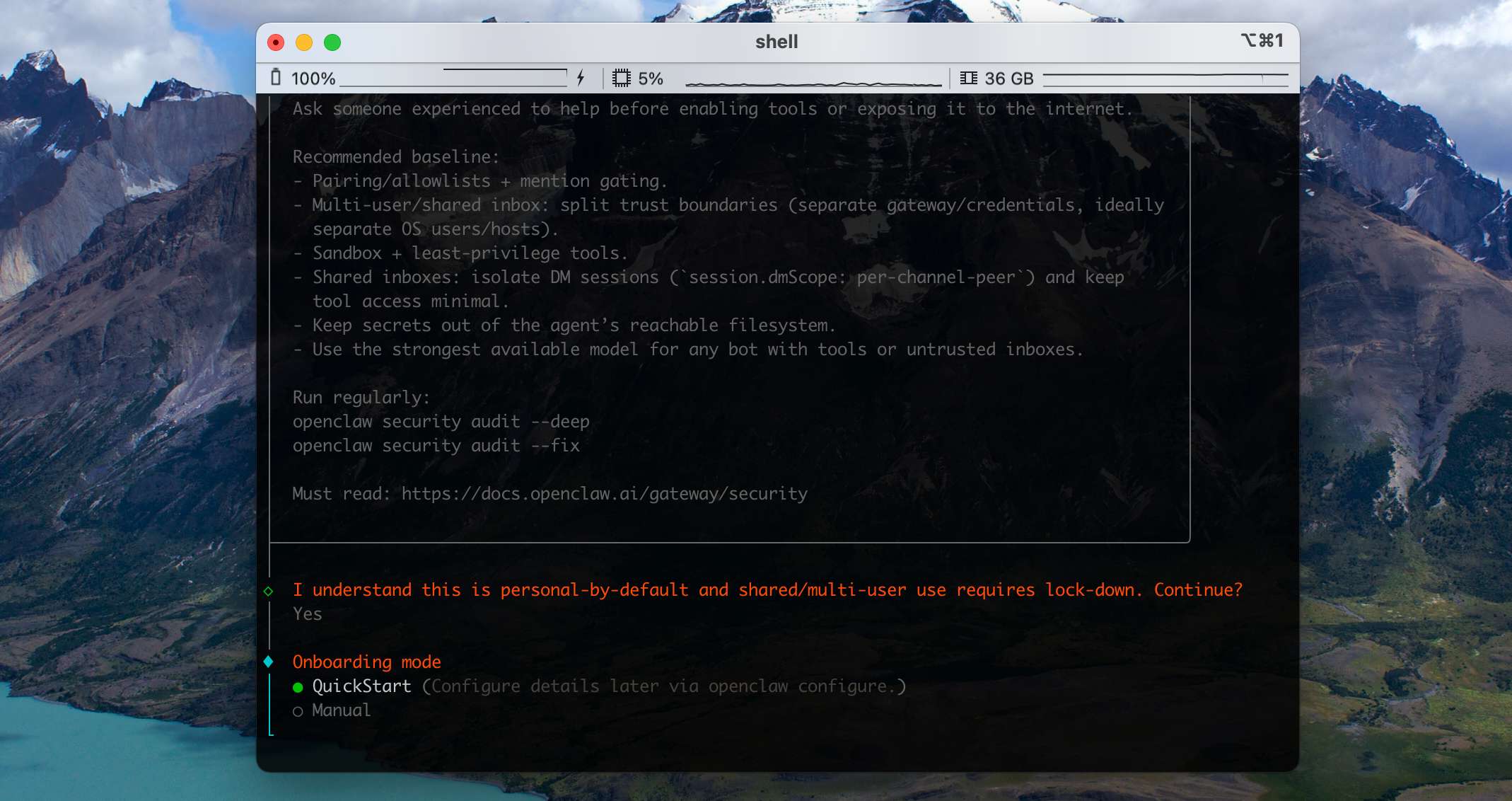

如果你认为当前环境足够安全(可以接受被攻击可破坏),选择 Yes

接下来会提示你选择配置模式,新手推荐选择 QuickStart,先快速跑起来,后续所有的配置都可以再进行更改。

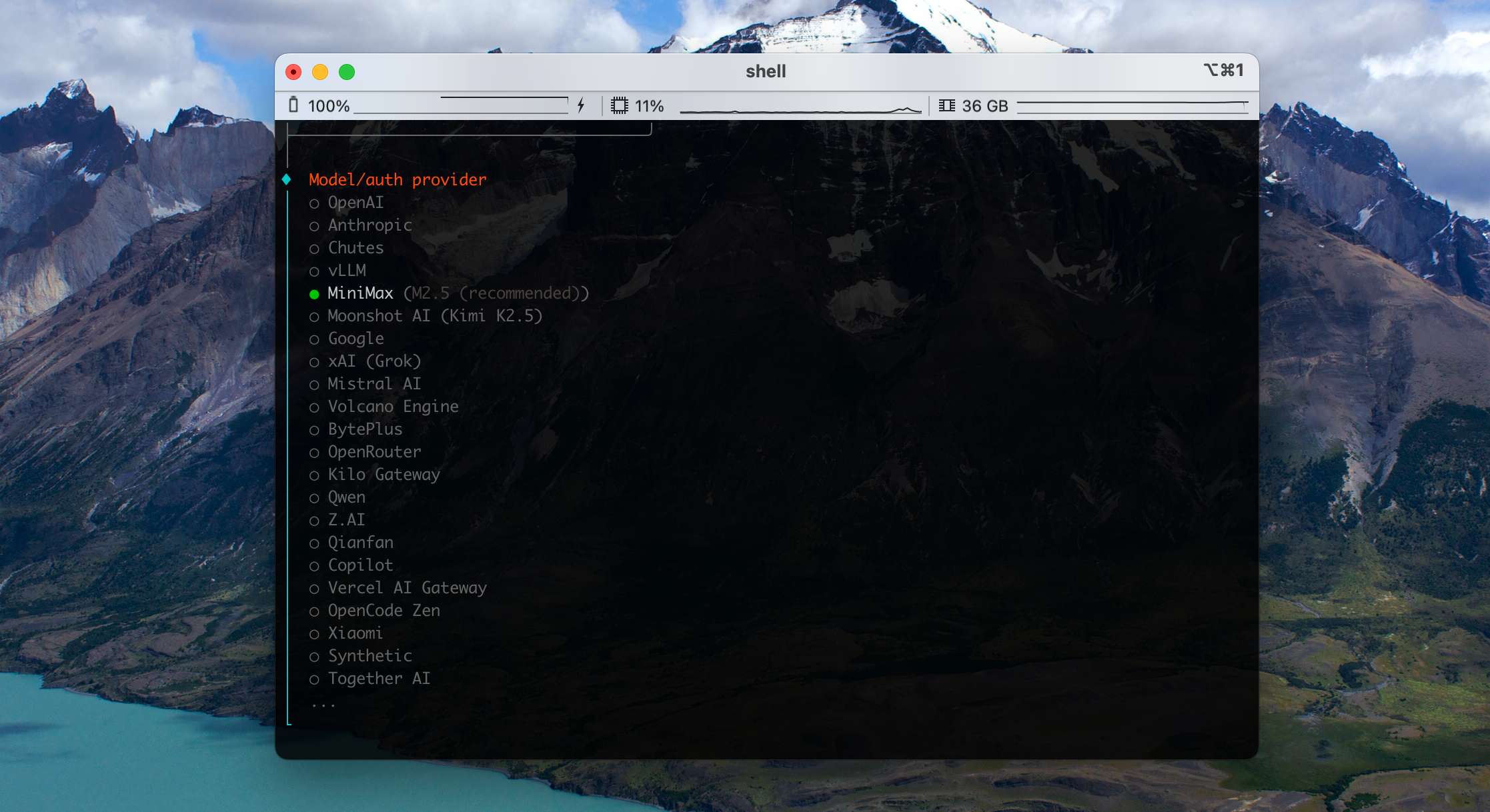

接下会提示你选择一个模型厂商,如果你不差钱,直接使用 Anthropic/OpenAI 的旗舰模型,效果是最好的。

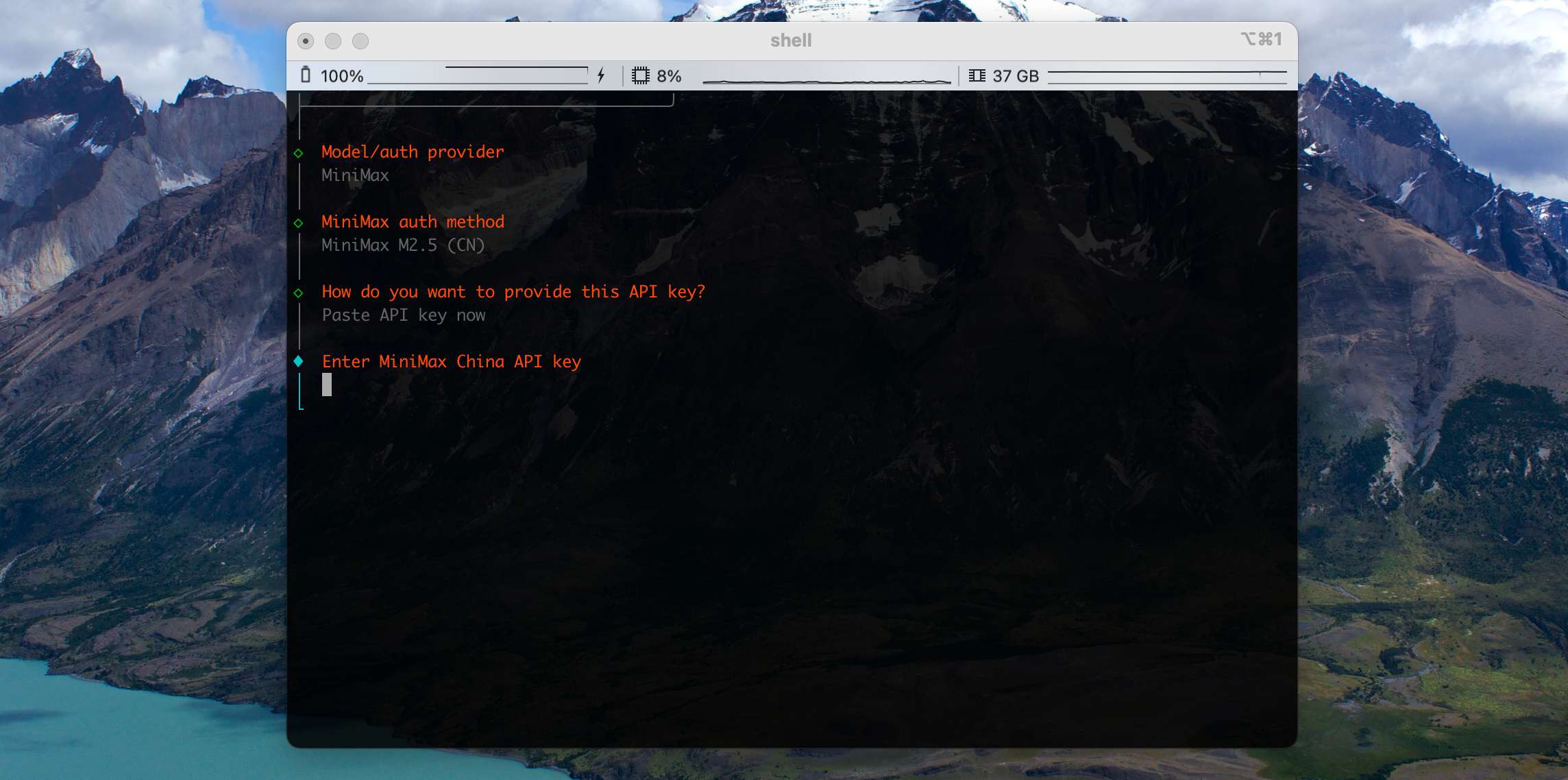

如果考虑性价比,可以选择国产的 GLM、MiniMax,Qwen 等,例如这里我们先尝试选择 MiniMax,接下来它会提示你配置 API Key:

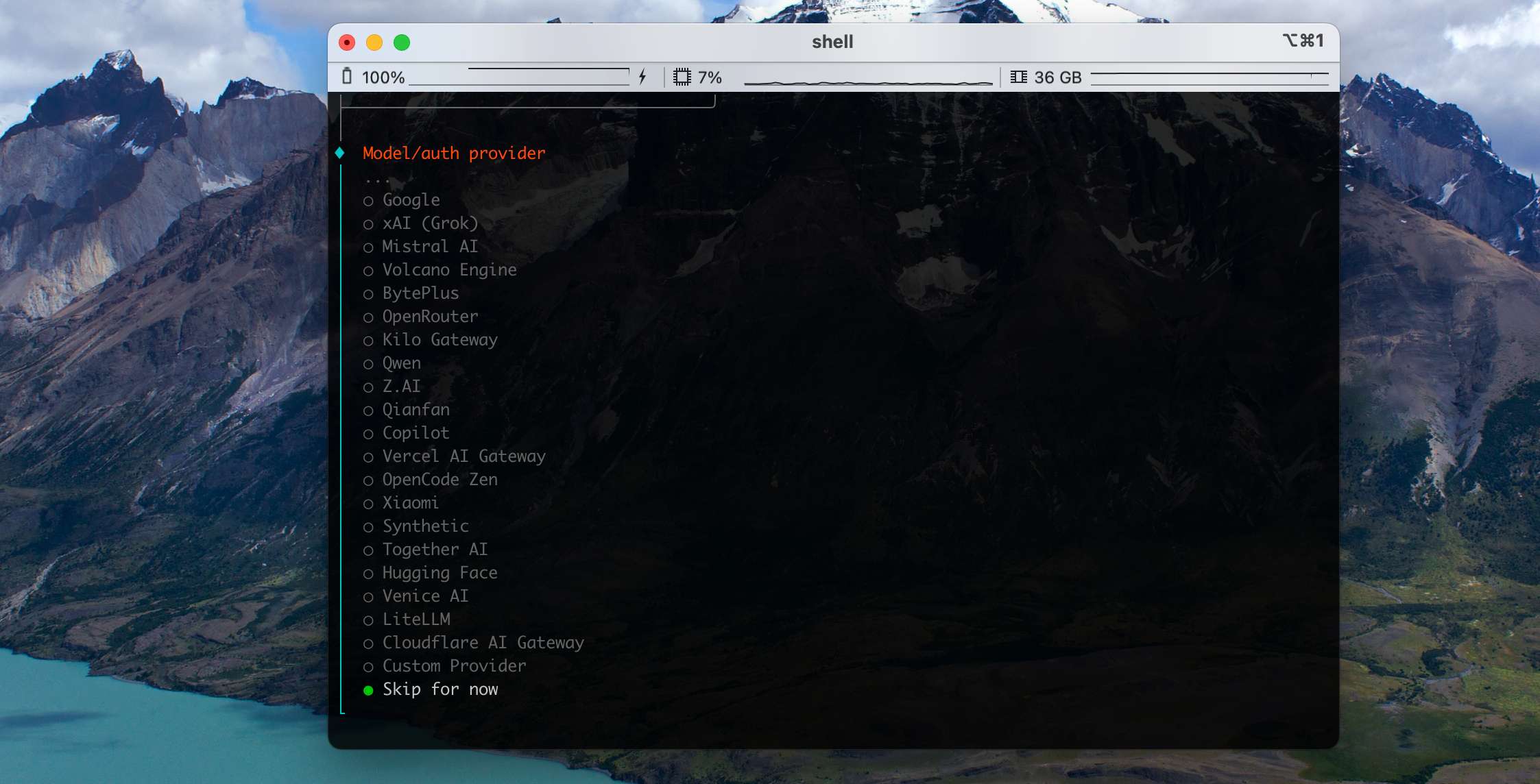

如果你要使用的模型厂商没有在推荐的列表中,或者你需要配置自定义的本地模型服务,可以先选择 Skip for now,后续我们在 Gateway 中进行配置。

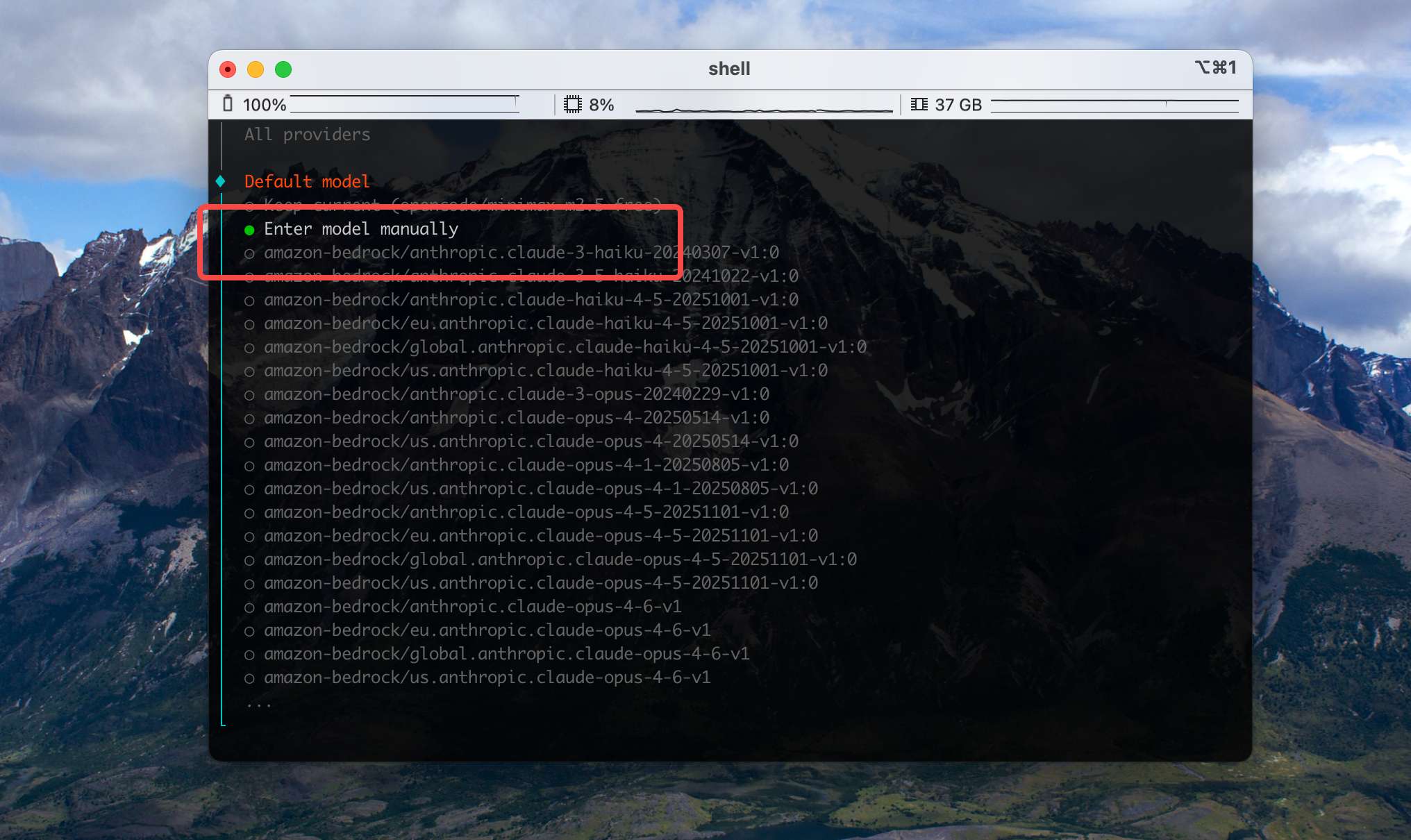

接下来是选择模型,根据你上一步选择的模型提供商选择合适的模型即可,如果你希望后续再自定义模型,这一步就选择 Enter model manually。

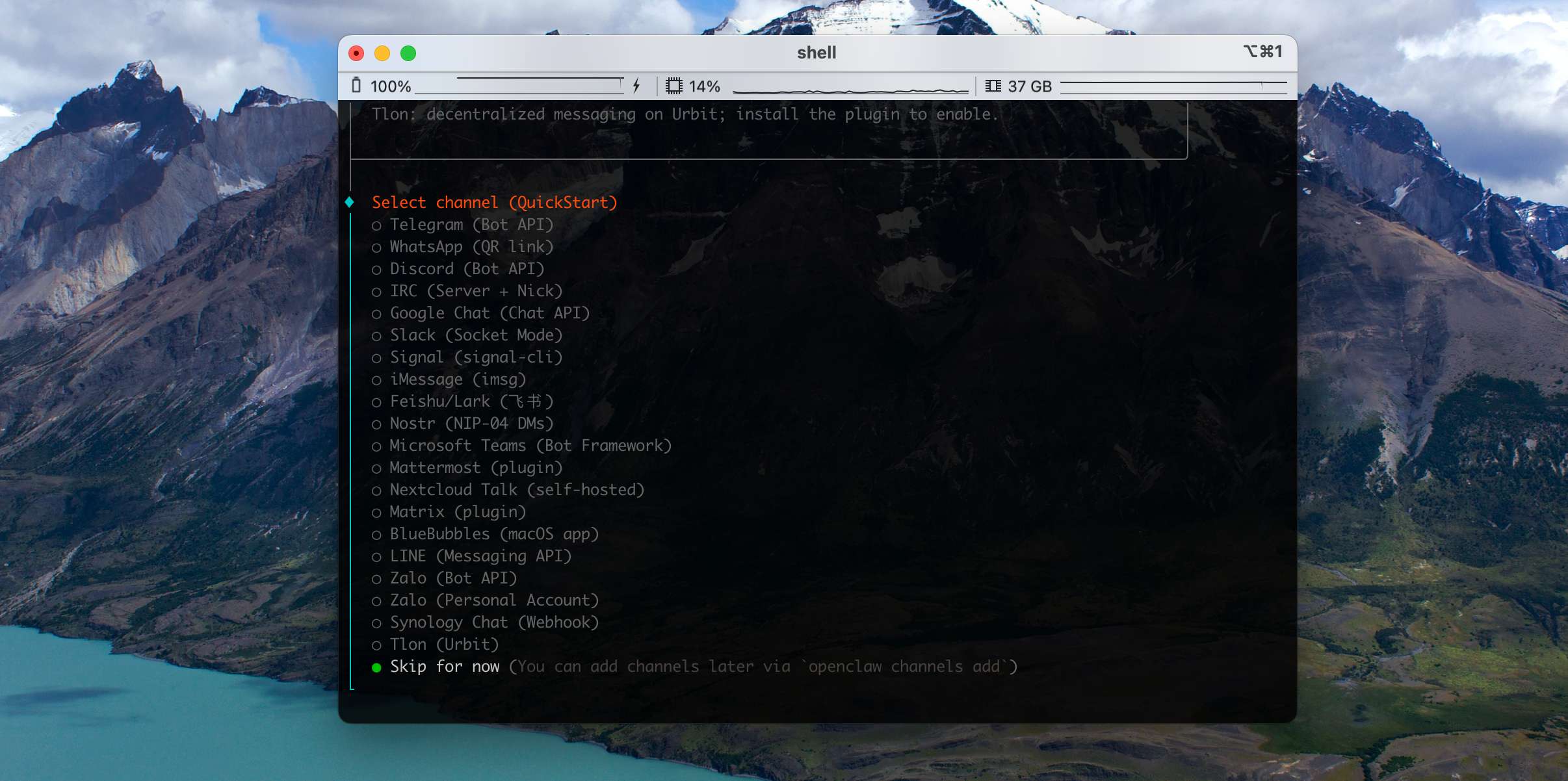

下一步就是提示你配置 Channel,这里我们还是先 Skip,我们尽量先保证基础的流程能够跑通再接入三方平台,这样排查问题比较方便。

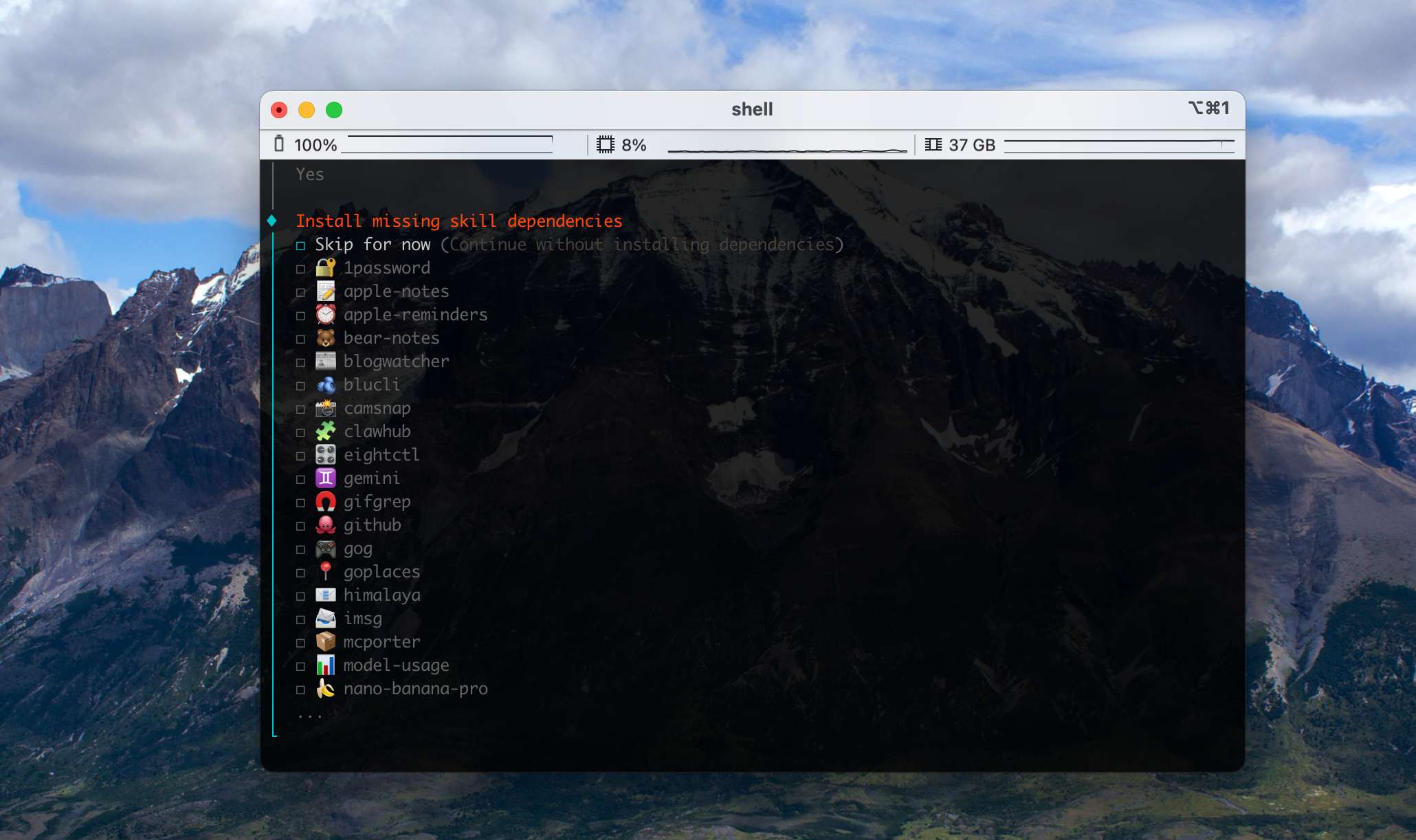

接下来会提示你安装 Skills,为了先跑通流程,我们仍选择 Skip for now,后续在网页中进行单独配置。

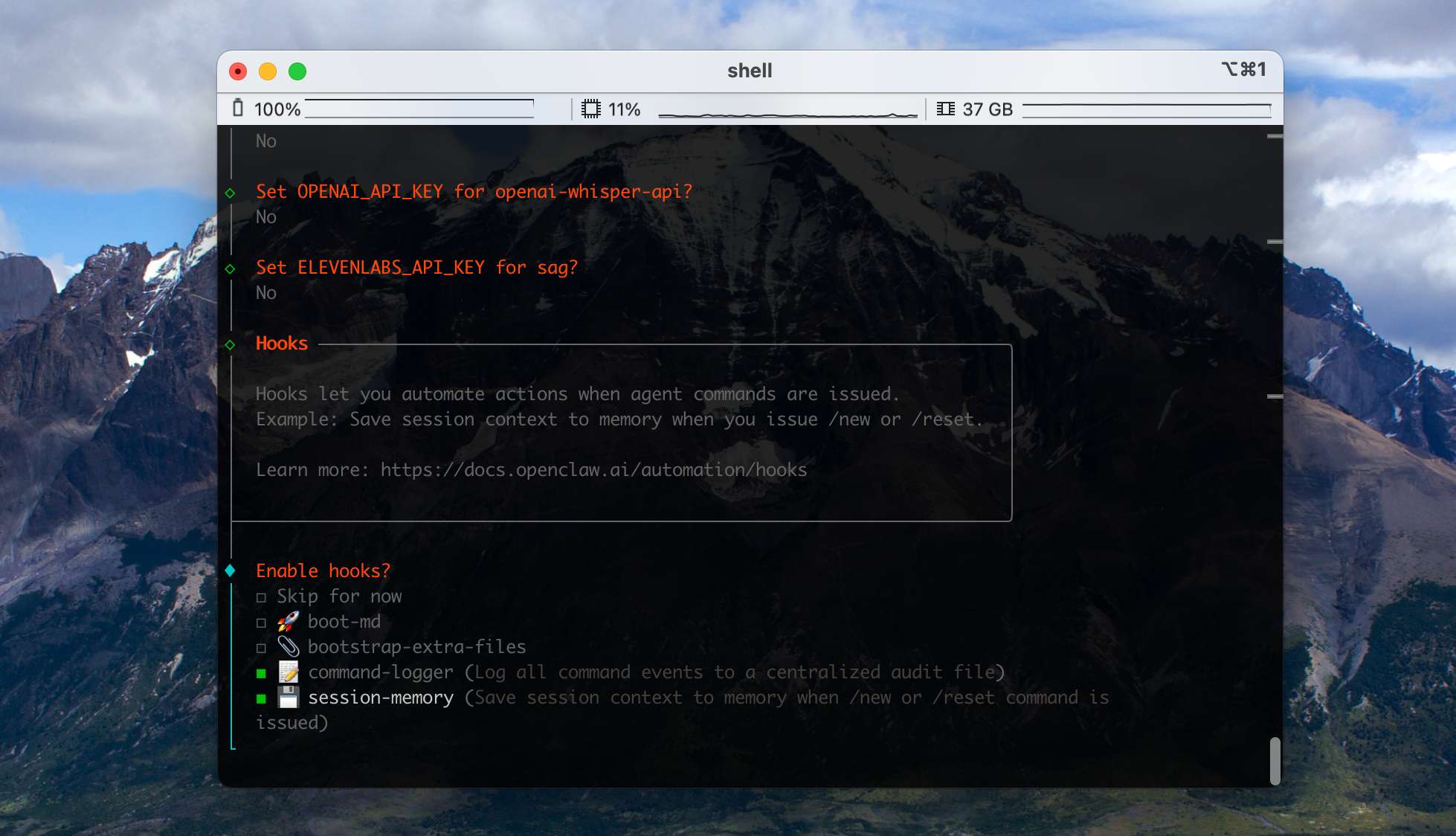

接下来会提示你配置 Hooks,这里有两个 Hooks 建议直接开启(空格选中)然后 Enter 即可:

- command-logger:将系统中所有命令相关的事件统一记录到一个集中的审计文件中,排查问题非常有用。

- session-memory:在用户执行 /new 或 /reset 命令时,将当前的会话上下文数据保存到内存中,避免会话状态丢失。

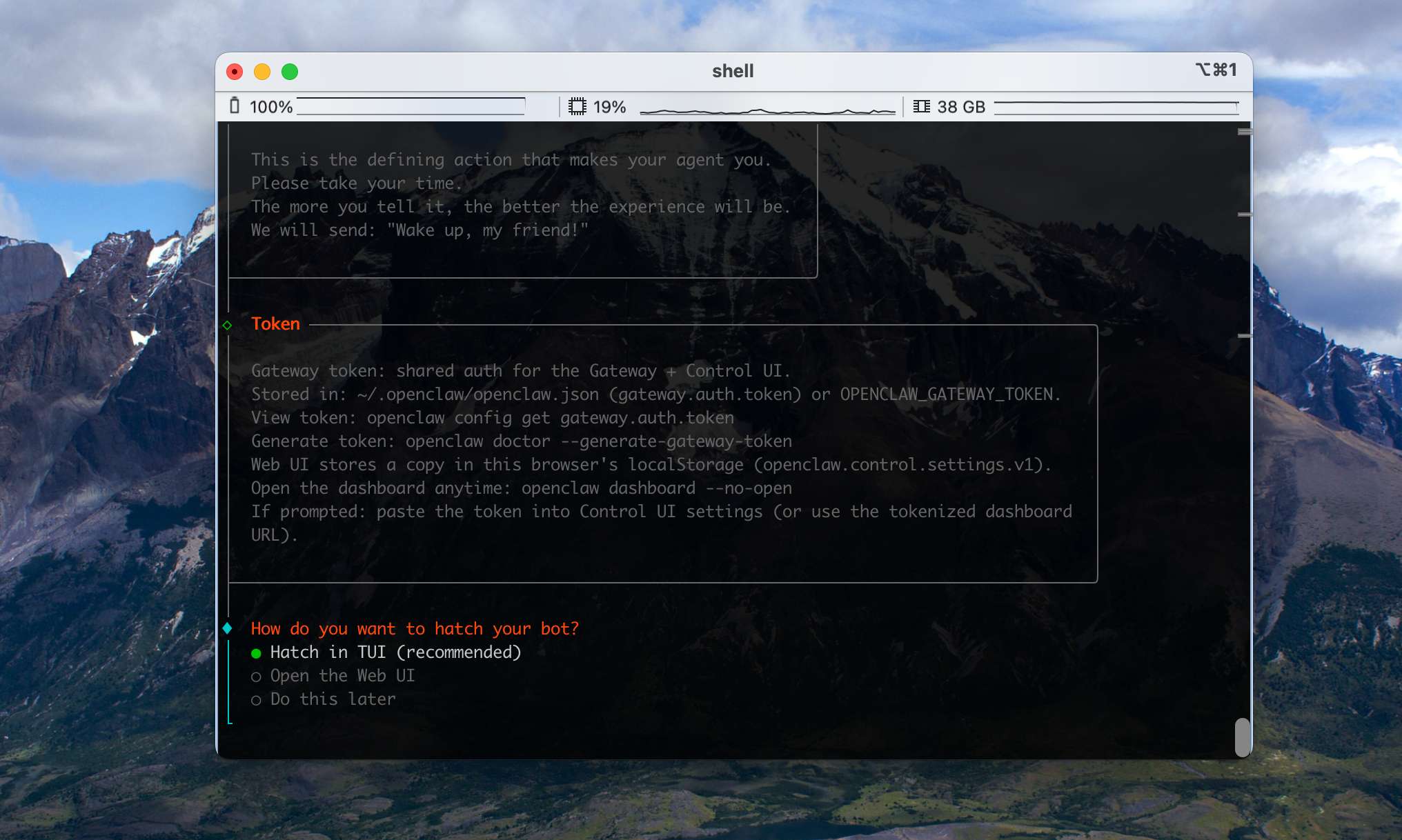

Hook 配置完成后,会自动进行网关的配置,然后选择我们选择 TUI 默认选项结束安装。

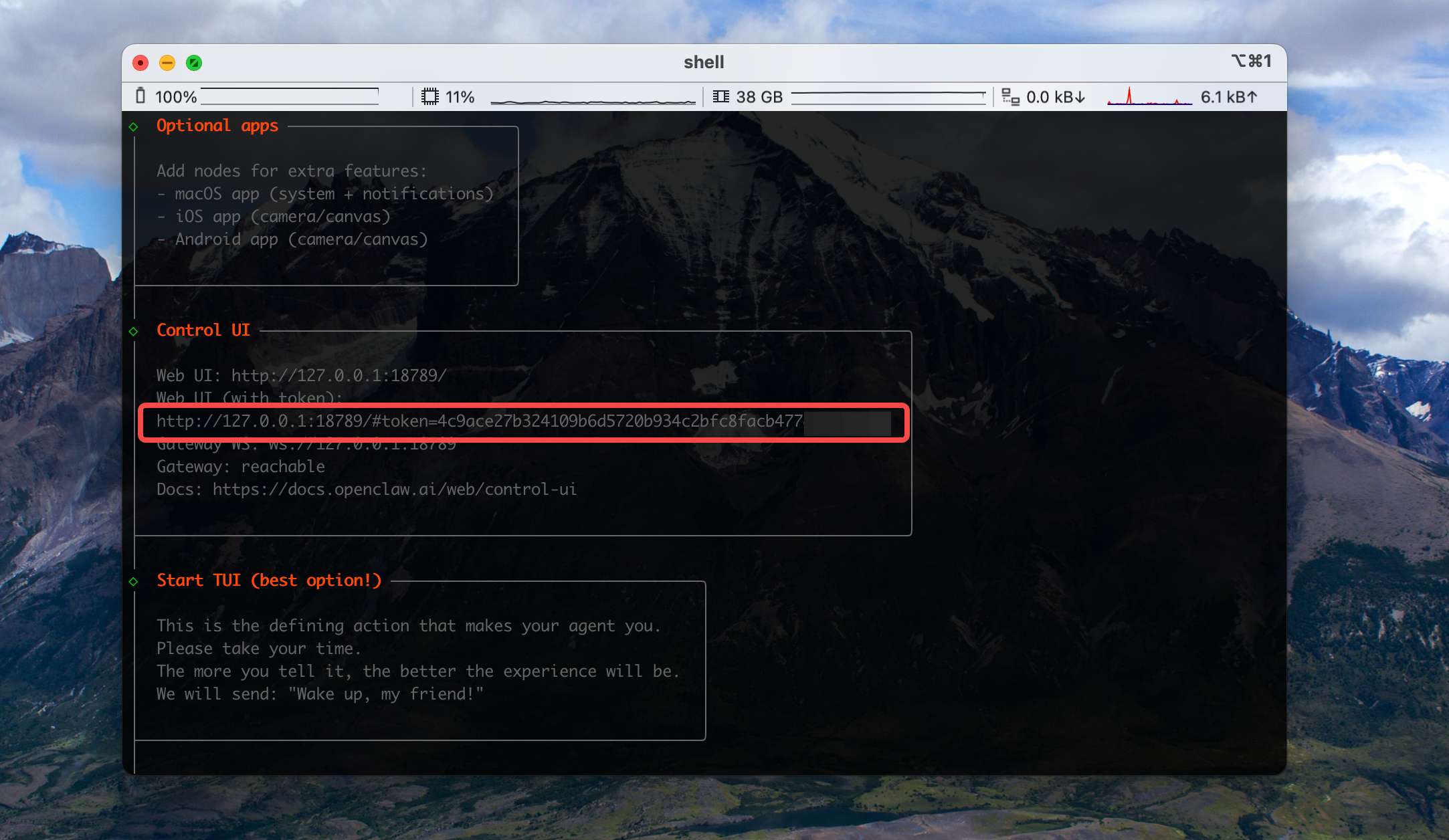

我们向前翻一下终端,可以看到带有 Token 的 WebUI 的地址:

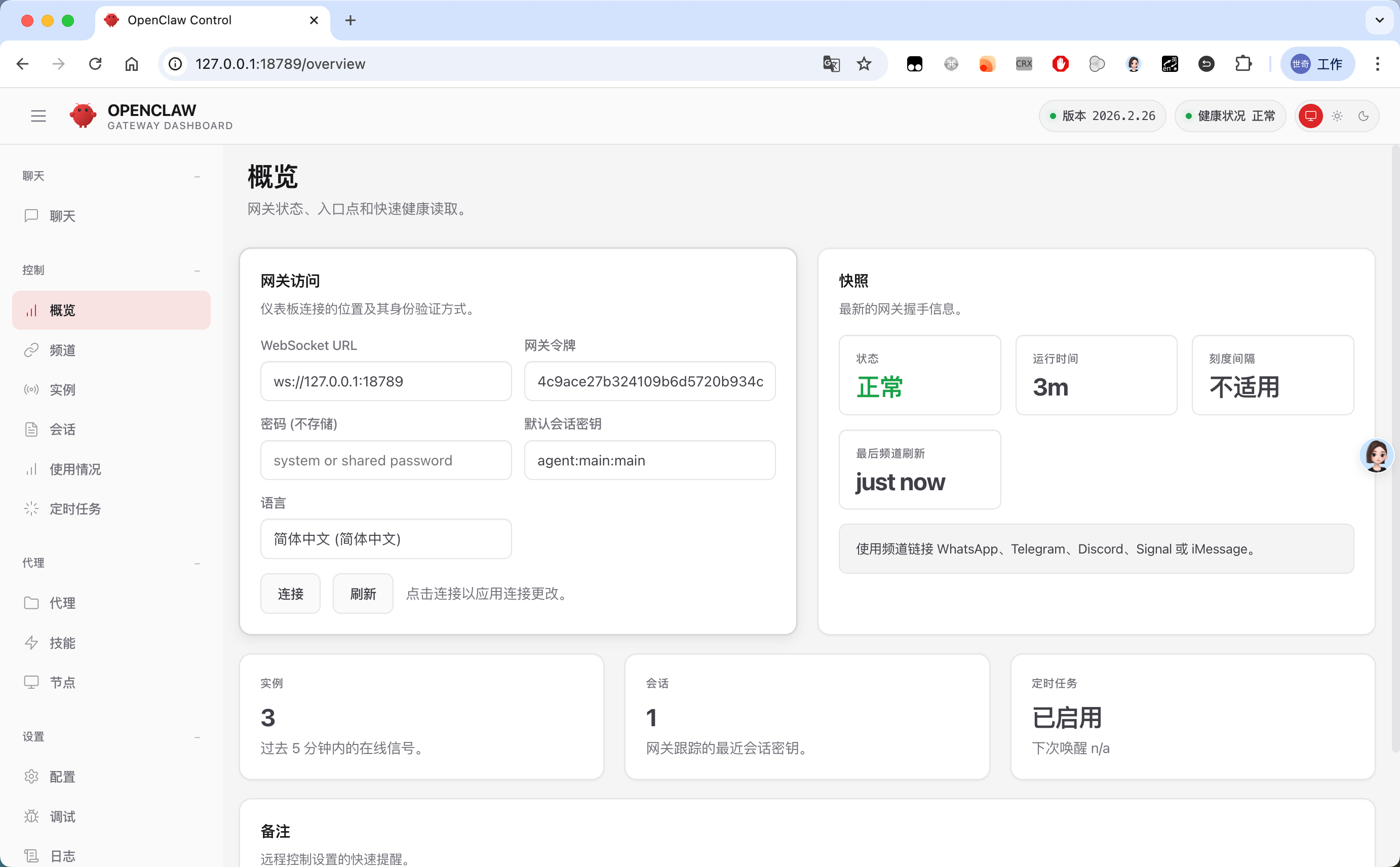

我们在浏览器中访问这个地址,如果正常出现 OpenClaw 控制台界面则代表安装过程已经成功:

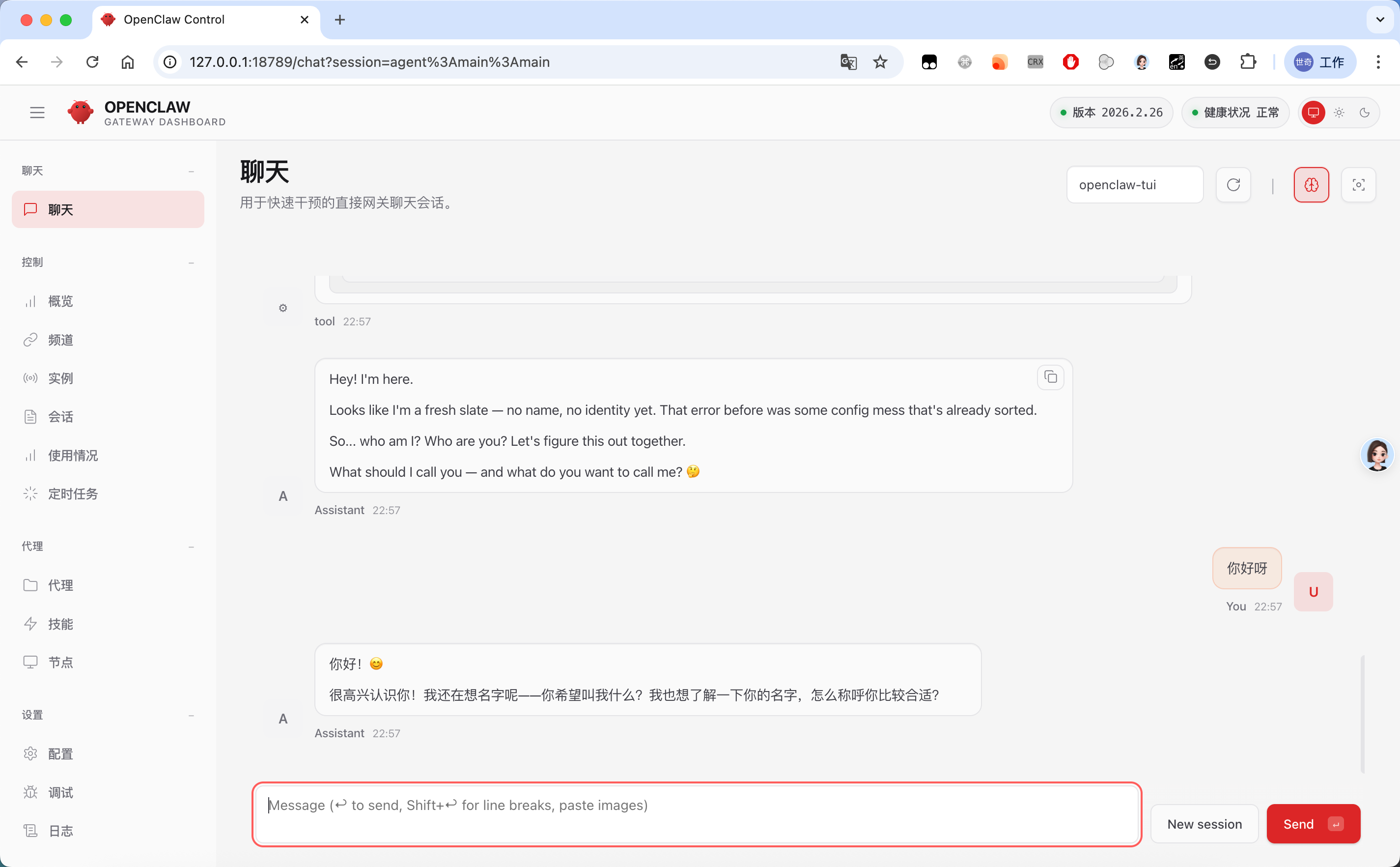

如果你刚刚在向导过程中已经配置过模型 API Key,现在就可以尝试和它进行对话了:

将任意大模型接入 OpenClaw

在这个章节中,你将学习到如何为 OpenClaw 配置自定义的大模型 API。

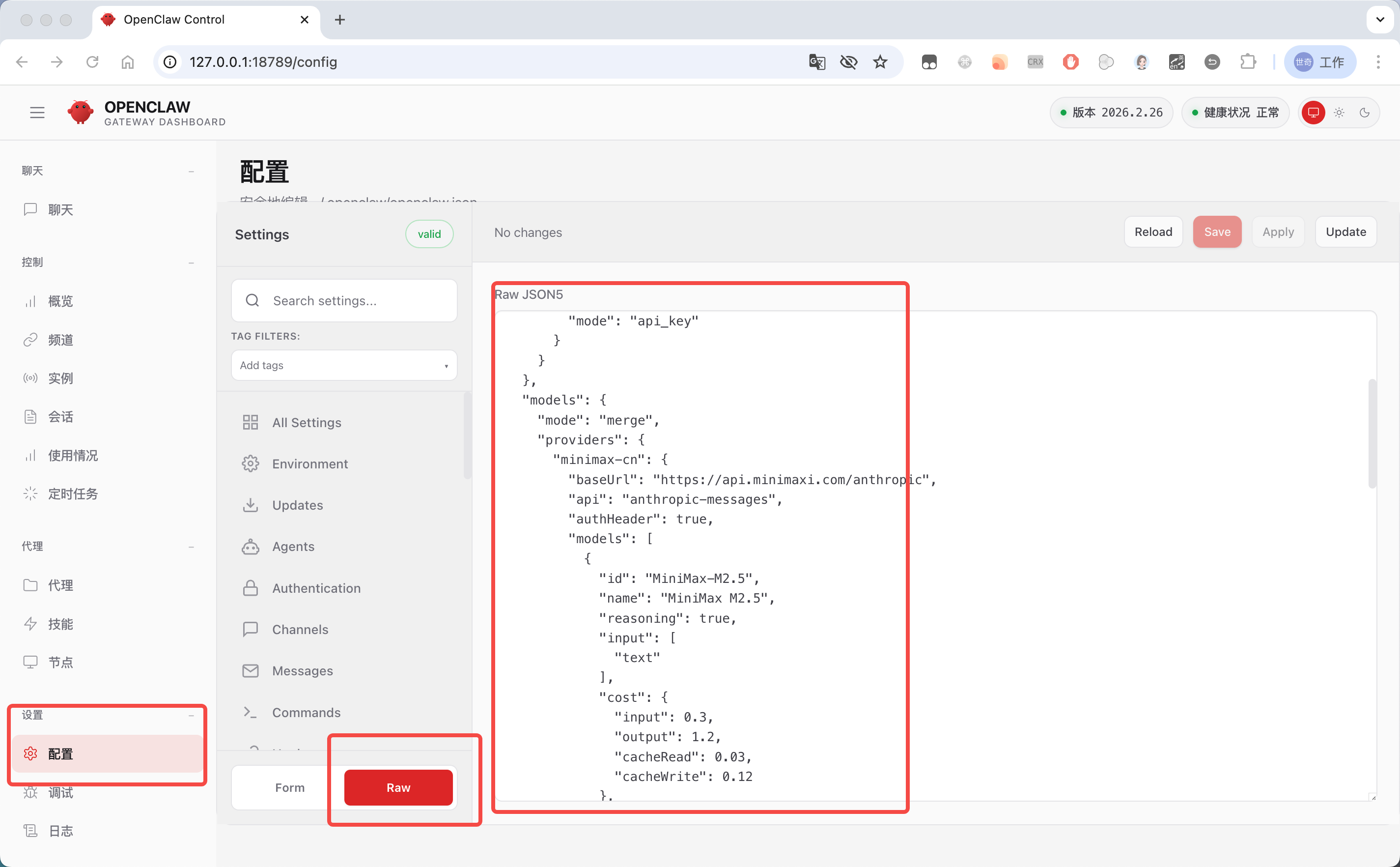

如果你在配置向导中跳过了模型相关配置,或者想追加更多自定义的模型,我们可以到控制面的配置模块。

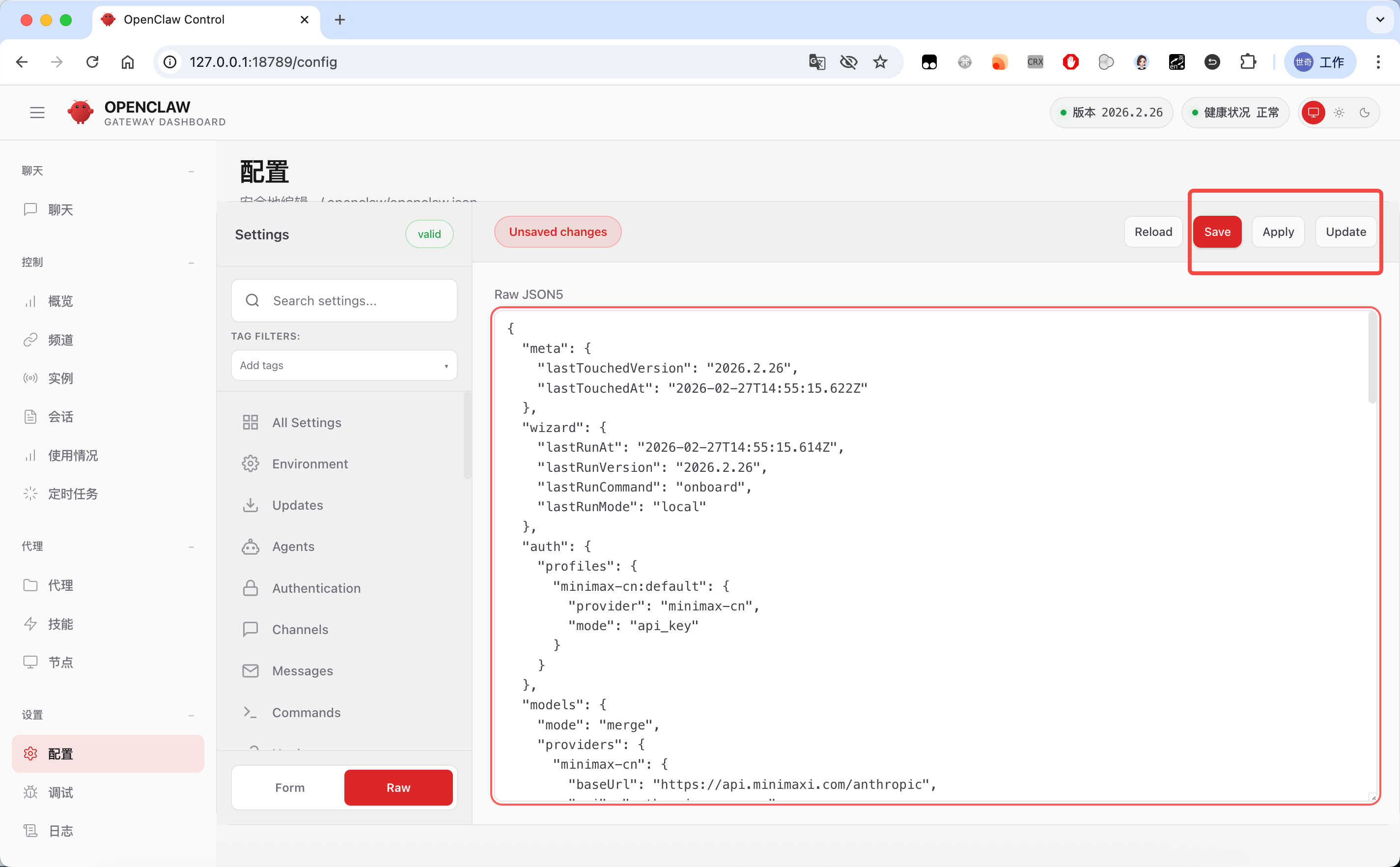

默认的表单形式目前体验不是很好,推荐大家直接选择 Raw 模式下进行配置:

这份 JSON 实际上就是 openclaw 的核心配置文件,它存放在 ~/.openclaw/openclaw.json。模型配置解读

openclaw 本身内置的配置模块并不具备对 JSON 文件进行格式化和高亮的能力,配置体验很差,建议直接在一些编辑器(如 VsCode )中打开这个文件进行配置:

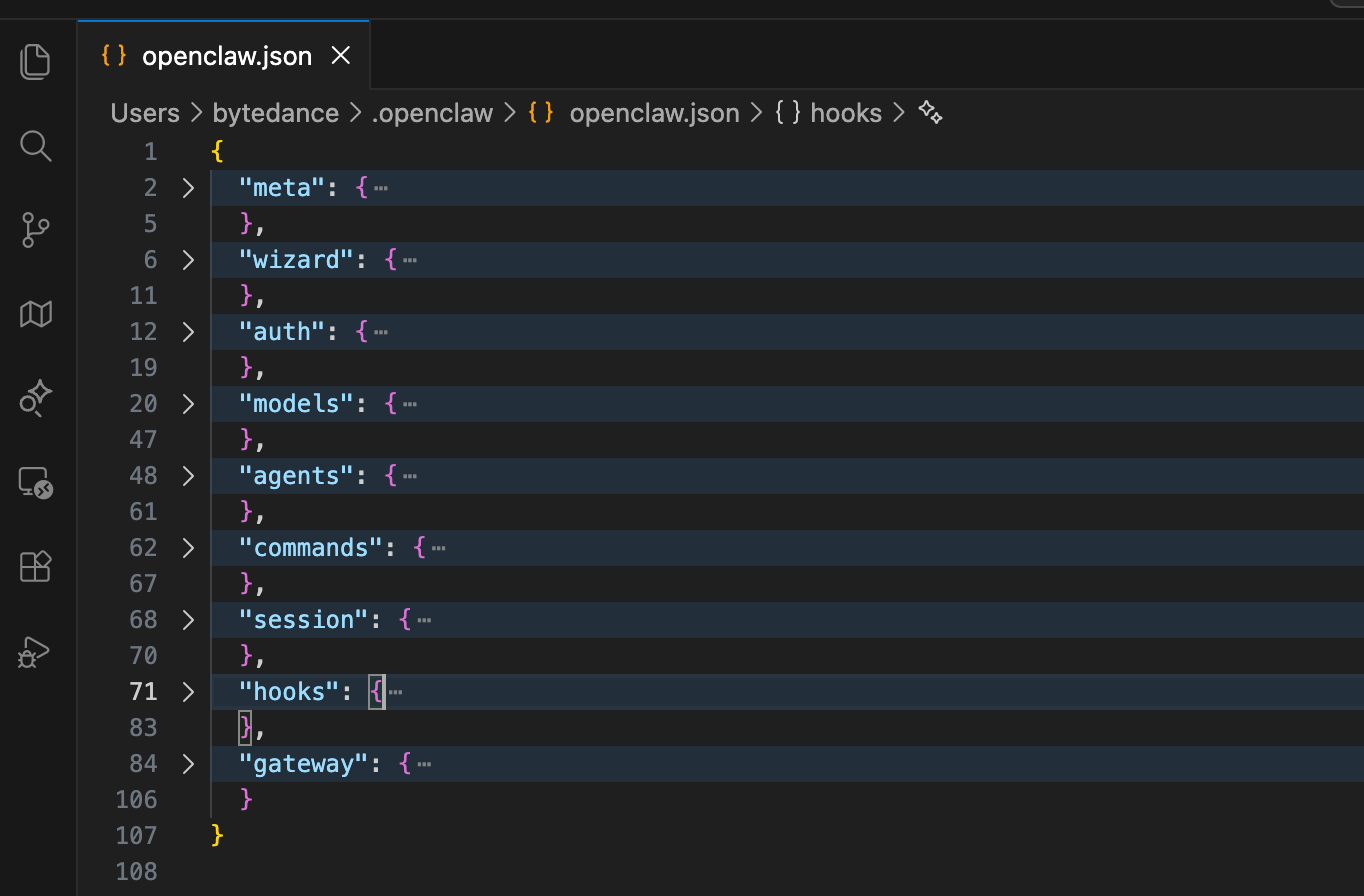

默认的配置很多,我们把一级 Key 收缩一下,整体上就是这几个分类:

- meta:元数据模块,记录配置文件的基础信息

- wizard:向导配置模块,记录交互式配置向导的运行记录

- auth:认证配置模块,管理模型提供商的认证信息

- models:模型提供商与模型元信息模块

- agents:智能体默认行为配置模块

- commands:命令执行配置模块,控制 OpenClaw 的命令运行规则

- session:会话管理配置模块,定义会话的作用域等规则

- hooks:钩子配置模块,管理内置的事件钩子 / 插件

- gateway:网关配置模块,控制 OpenClaw 的网络服务(端口、认证、访问控制等)

这里模型的配置我们需要用到 models 和 agents 两份配置,我们将它展开,因为之前我们在向导中已经配置了 MiniMax 的模型,这里已经有一份默认的配置了:

{

"models": {

"mode": "merge",

"providers": {

"minimax-cn": {

"baseUrl": "https://api.minimaxi.com/anthropic",

"api": "anthropic-messages",

"models": [

{

"id": "MiniMax-M2.5",

"name": "MiniMax M2.5",

"reasoning": true,

"input": [

"text"

],

"cost": {

"input": 0.3,

"output": 1.2,

"cacheRead": 0.03,

"cacheWrite": 0.12

},

"contextWindow": 200000,

"maxTokens": 8192

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "minimax-cn/MiniMax-M2.5"

},

"models": {

"minimax-cn/MiniMax-M2.5": {

"alias": "Minimax"

}

}

}

}

- 顶级字段

models:模型提供商与模型元信息

这部分是 OpenClaw 识别「自定义模型提供商」的核心配置,告诉系统「去哪里调用模型」「模型的参数/计费规则是什么」。

- 顶级字段

agents:智能体默认行为配置

这部分定义 OpenClaw 智能体的默认使用规则,比如「默认用哪个模型」「哪些模型可以用(白名单)」「模型的快捷别名」。

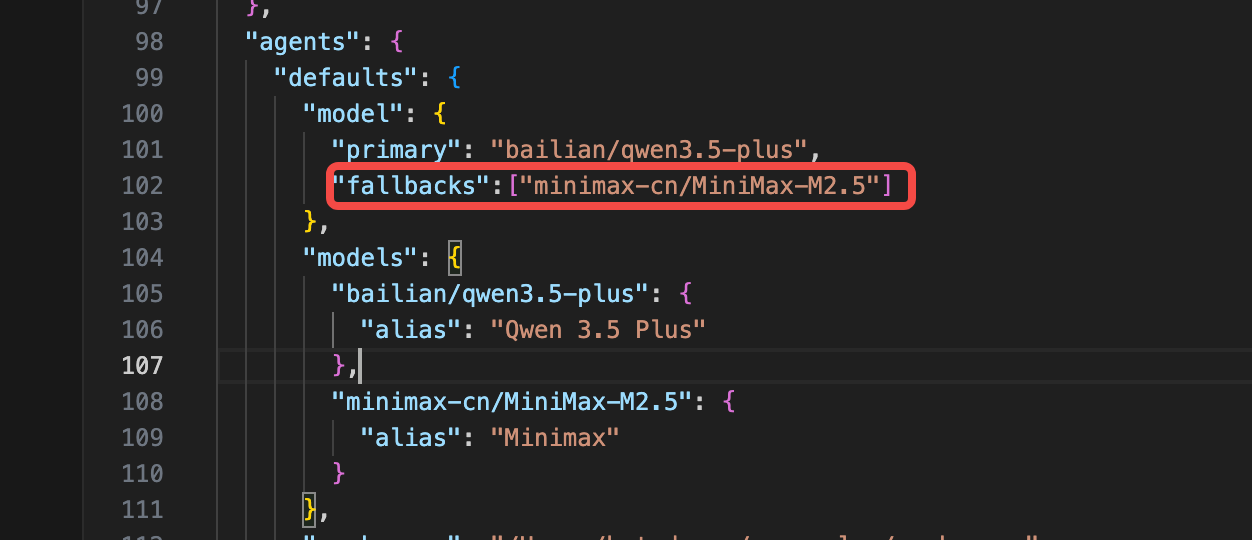

自定义模型配置

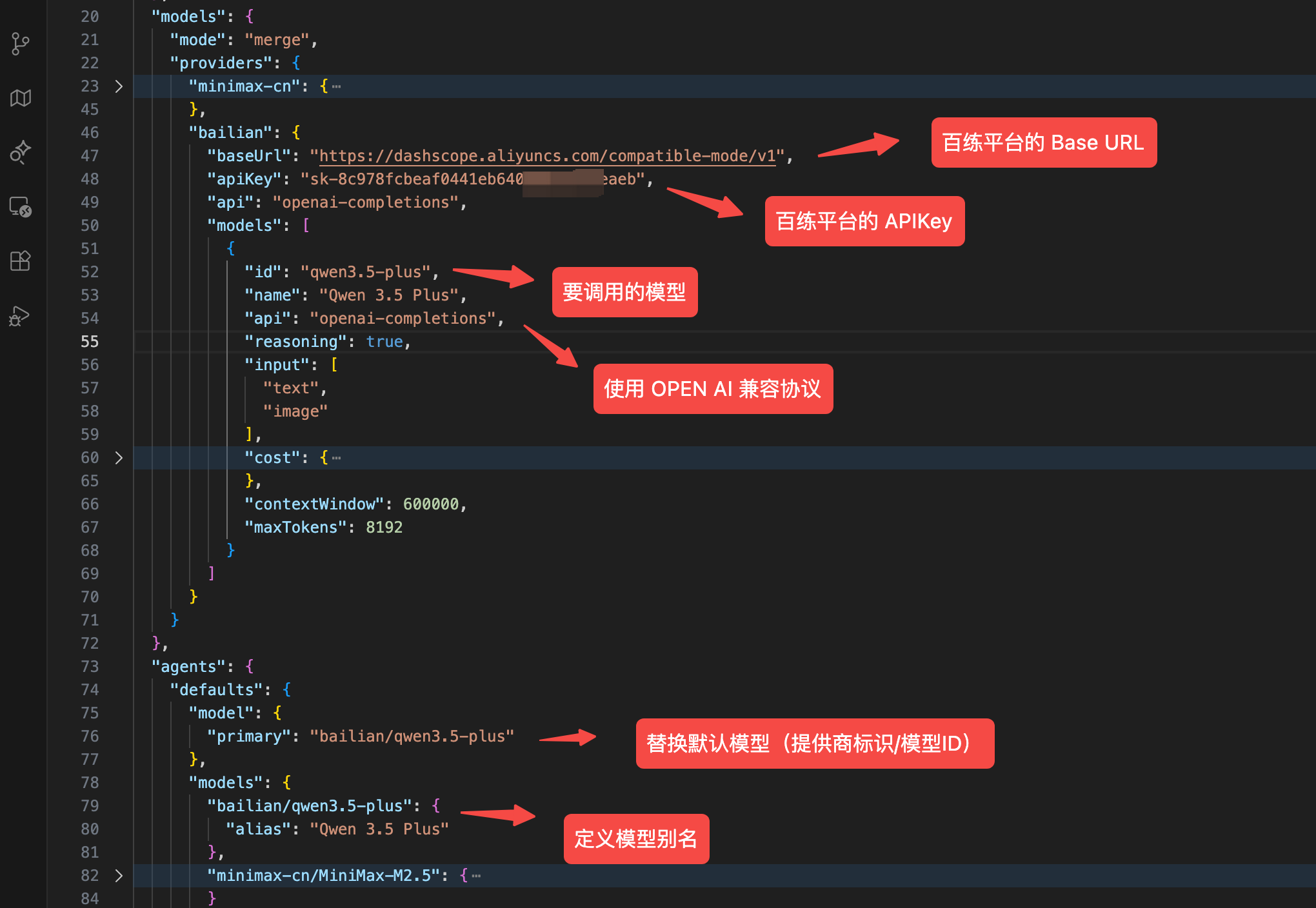

按照这个格式,我们可以继续添加更多的模型配置,比如我们再添加一个阿里云百练的模型:

在 providers 添加一个新的 key(bailian,可以随便自定义),然后配置模型的 baseUrl、apiKey、模型 Id,支持输入文字和图片、开启推理,更改上下文窗口和最大输出 Token。

最后在 agents 的 defaults 下配置一下刚添加的模型,并且将默认模型(model.primary)切换为此模型。

然后我们将这份配置复制到控制面板中的 配置 - Raw JSONS 中,点击 Save 和 Update,然后它会更新配置和重启服务(需要等待一段时间)。

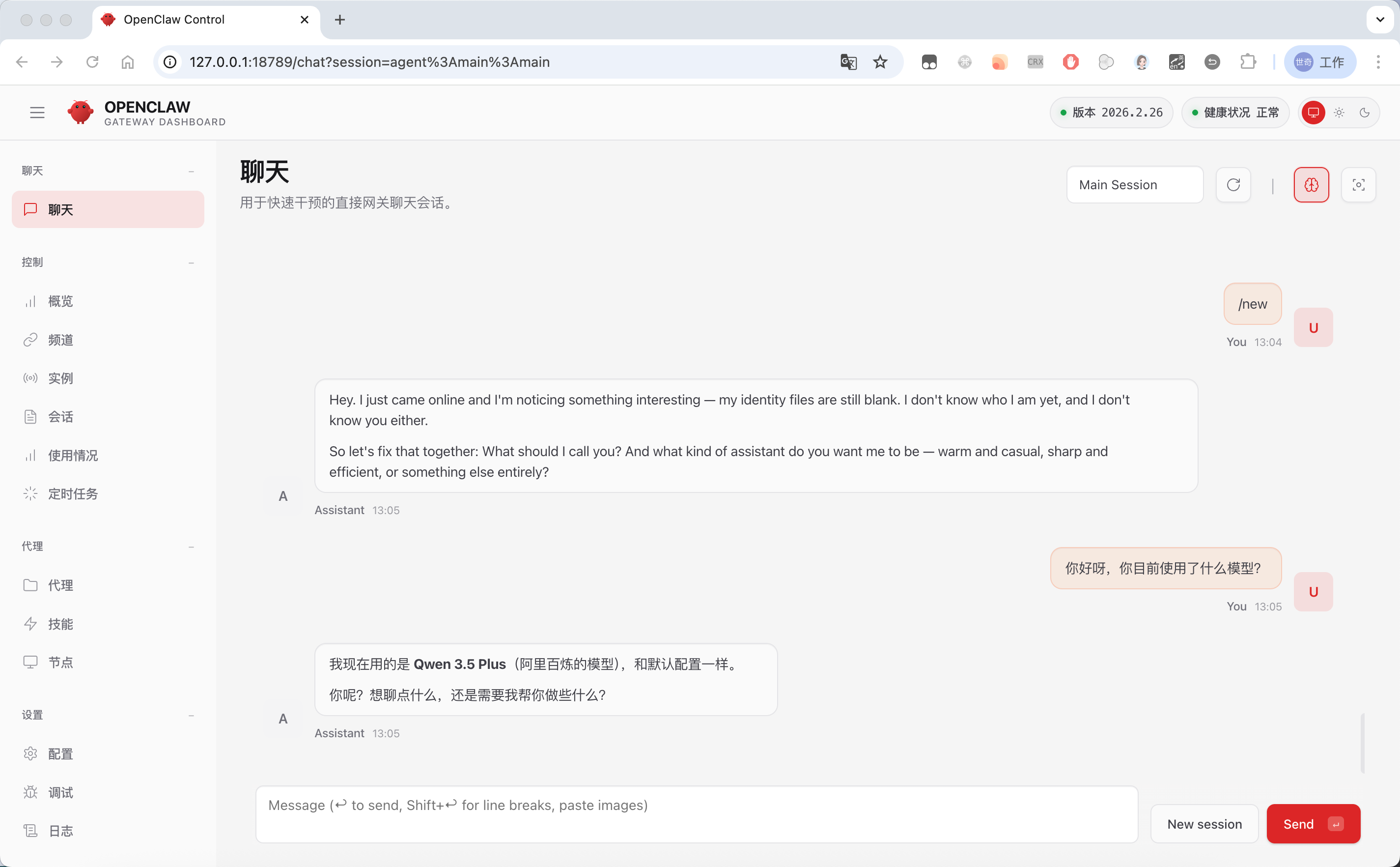

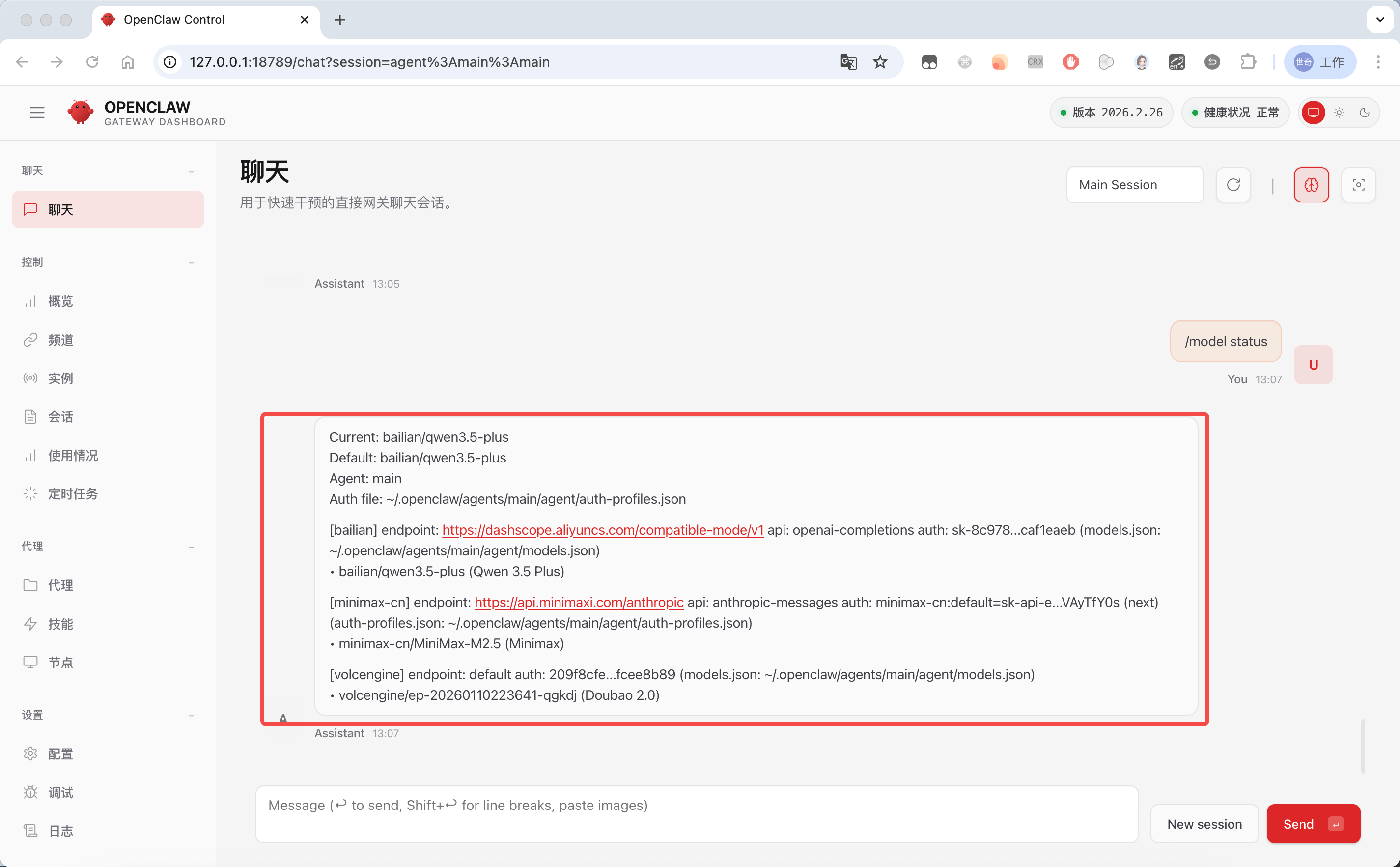

接下来我们到聊天中测试一下:

在聊天框输入 /model status 指令可以查看当前已经配置好的所有模型

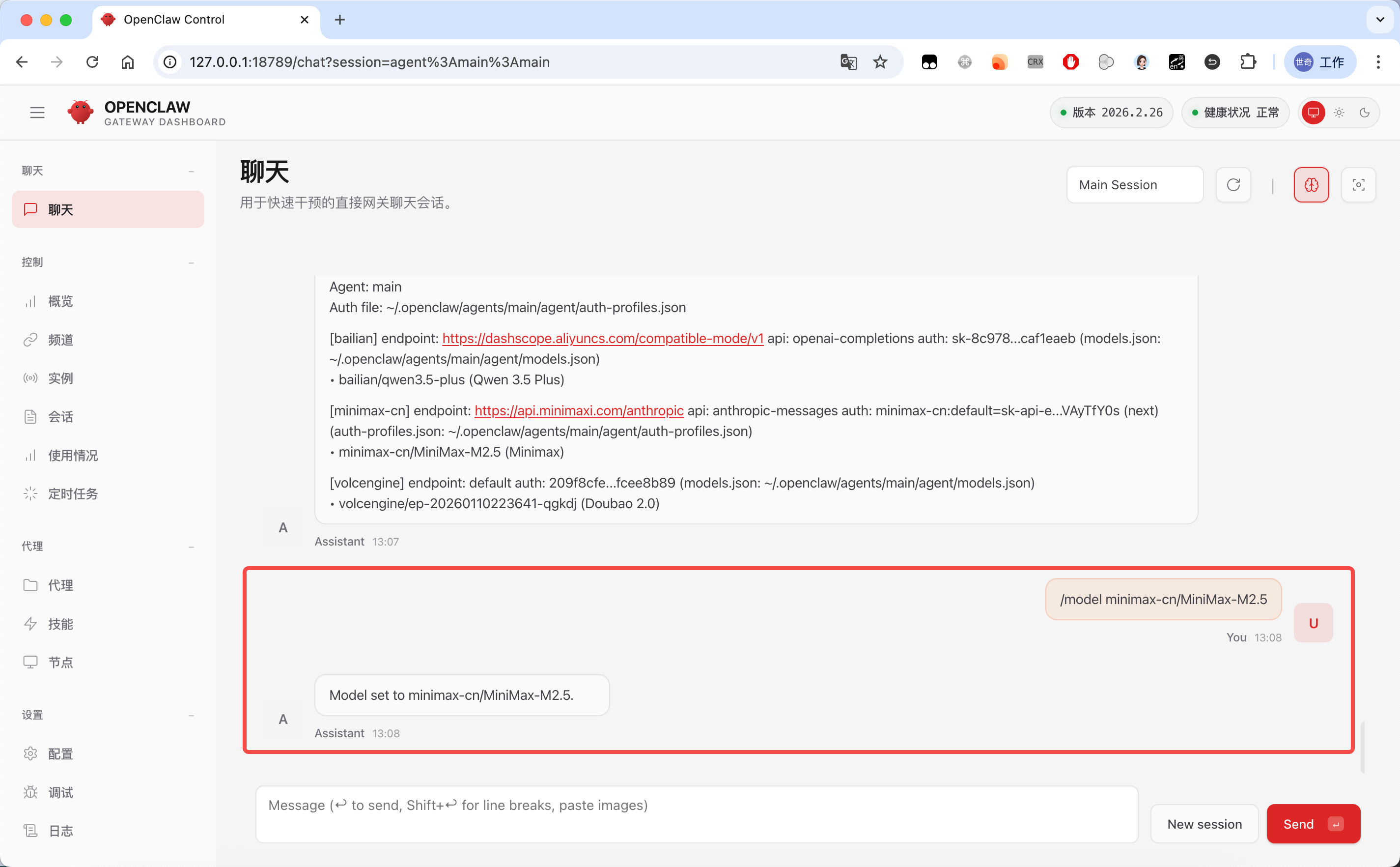

如果你配置过多个模型,可以使用 /model 模型标识 快捷切换模型:

模型回退机制

openclaw 运行起来是非常烧 Token 的,如果你的模型 TPM 比较低,很容易超限导致任务失败。并且如果只配置单一的模型提供商也可能会因为提供商故障或者余额不足导致失败等情况。

opencraw 为此额外提供了一个回退机制,我们可以在 defaults.model 下增加一个 fallbacks 字段,这里可以配置当主模型出现故障时可以使用的备用模型。